التكنولوجيا اليومية

·01/04/2026

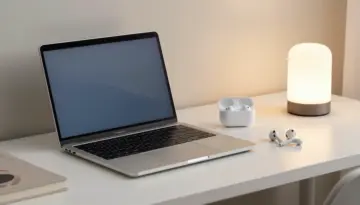

أولاما، وهو وقت تشغيل شائع لنماذج اللغة الكبيرة المحلية، قد عزز بشكل كبير أدائه على أجهزة Mac المزودة بشرائح Apple Silicon. يقدم التحديث الأخير دعمًا لإطار عمل MLX مفتوح المصدر من Apple، مما يعد بتنفيذ أسرع لنماذج الذكاء الاصطناعي مباشرة على أجهزة المستخدمين. يأتي هذا التطور في الوقت الذي تكتسب فيه نماذج الذكاء الاصطناعي المحلية زخمًا خارج المجتمعات المتخصصة، مدفوعة بطلب المستخدمين على بدائل للخدمات المكلفة المستندة إلى السحابة.

يعد دمج MLX في أولاما خطوة كبيرة إلى الأمام لمستخدمي Mac المهتمين بتشغيل نماذج الذكاء الاصطناعي محليًا. MLX هو إطار عمل من Apple مصمم لتحسين مهام التعلم الآلي على Apple Silicon، مما يتيح حسابات أسرع واستخدامًا أكثر كفاءة لموارد الأجهزة. هذا يعني أن المهام مثل إنشاء التعليمات البرمجية، وتلخيص النصوص، وعمليات أخرى مدفوعة بالذكاء الاصطناعي يمكن تنفيذها بسرعة أكبر واستجابة أفضل على أجهزة Mac المتوافقة.

توقيت تحديث أولاما ذو صلة خاصة. أدى الارتفاع في شعبية النماذج مفتوحة المصدر، والتي تتجلى في مشاريع مثل OpenClaw، إلى تحفيز تجارب واسعة النطاق لتشغيل نماذج الذكاء الاصطناعي على أجهزة الكمبيوتر الشخصية. يبحث المطورون بشكل متزايد عن حلول محلية لتجاوز حدود المعدل وتكاليف الاشتراك المرتبطة بخدمات الذكاء الاصطناعي المستندة إلى السحابة مثل ChatGPT Codex و Claude Code. تعالج تحسينات أولاما مباشرة هذه الحاجة المتزايدة لقدرات الذكاء الاصطناعي المحلية سهلة الوصول وفعالة من حيث التكلفة.

دعم MLX الجديد متاح حاليًا في إصدار معاينة من أولاما (0.19). بينما يعد بتحسينات كبيرة في الأداء، فإنه يأتي مع متطلبات أجهزة محددة. سيحتاج المستخدمون إلى جهاز Mac مزود بشريحة Apple Silicon (M1 أو أحدث) وبحد أدنى 32 جيجابايت من ذاكرة الوصول العشوائي لاستخدام هذه الميزة بفعالية. حاليًا، يقتصر دعم MLX على نموذج Qwen3.5 من Alibaba في متغيره ذي 35 مليار معلمة. بالإضافة إلى MLX، قامت أولاما أيضًا بتحسين آليات التخزين المؤقت الخاصة بها وأضافت دعمًا لتنسيق NVFP4 من Nvidia، مما يعزز كفاءة الذاكرة بشكل أكبر لبعض النماذج المضغوطة.